画像に対して照明効果やカラーリングを指定して画像を生成する - Stable Diffusion

Stable Diffusionで元画像に対して、照明効果やカラーリングを指定して画像を生成する手順を紹介します。

概要・やりたいこと

下図の画像があります。構図や題材はそのままにして、天窓から光が差し込んでいる効果と周囲を暗くする効果を追加したいです。

元画像:1456x816

Photoshopで編集した完成イメージは下図ですが、画像生成で、より自然な照明効果を出したいです。できればもう少しイラスト感も出したいです。

こちらの記事

こちらの記事で紹介した、img2imgを利用して画像の全体のカラーを指定する方法とContorlNetを組み合わせて実現します。

手順

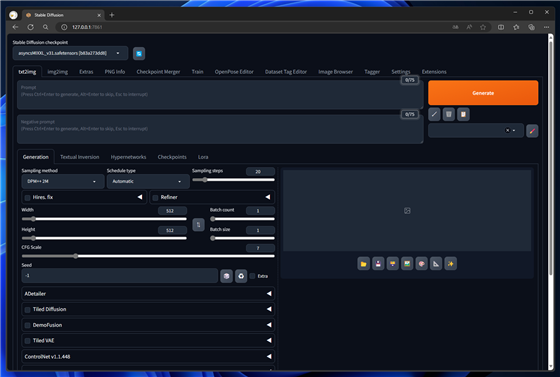

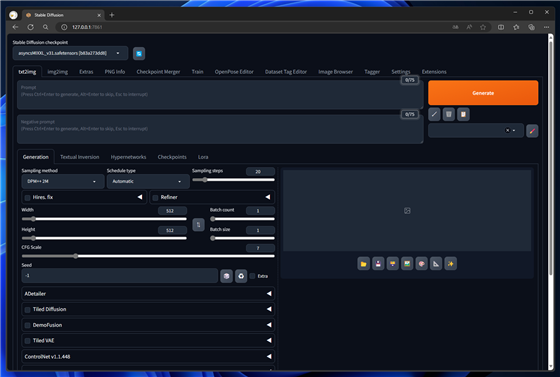

Stable Diffusion Web UIを表示します。

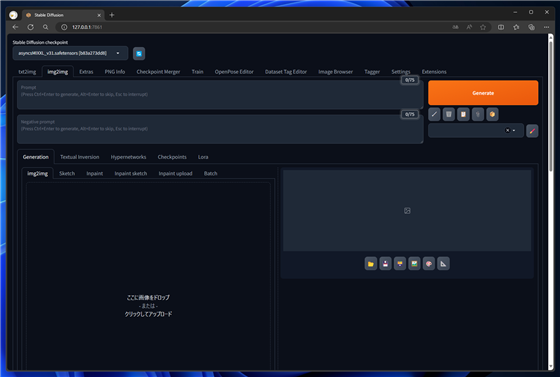

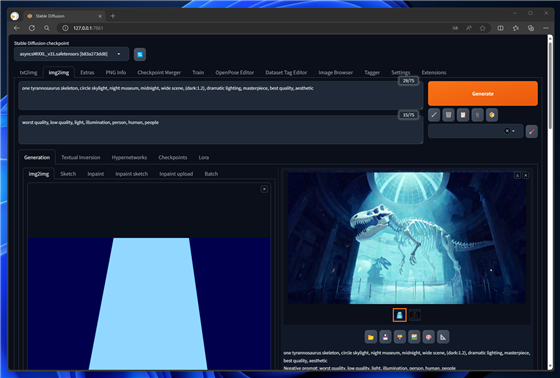

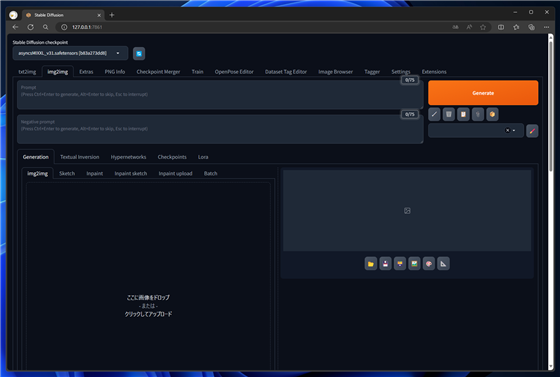

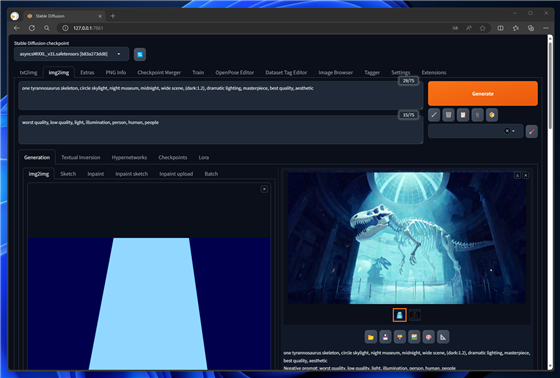

上部のタブで[img2img]を選択します。下図の画面に切り替わります。

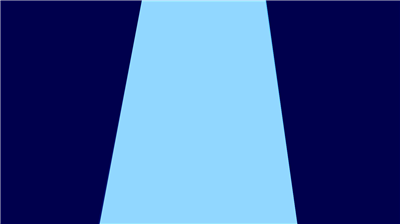

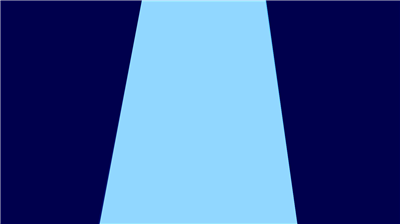

下図の画像を準備します。画像サイズは元画像と同じ1456x816です。カラーリングを指定する画像です。周囲を暗い青にして、天窓から明るい水色の光が差し込むイメージを用意しました。

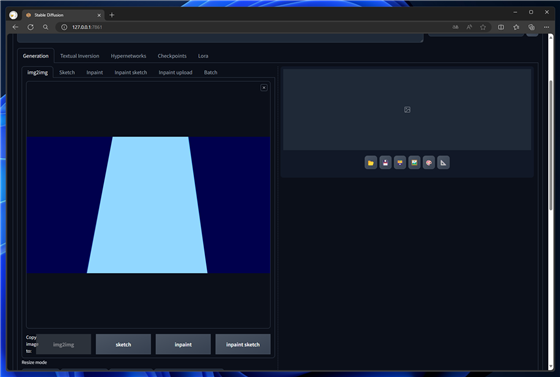

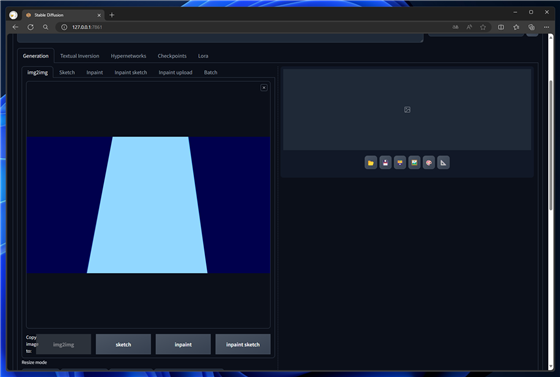

img2imgの画像に設定します。

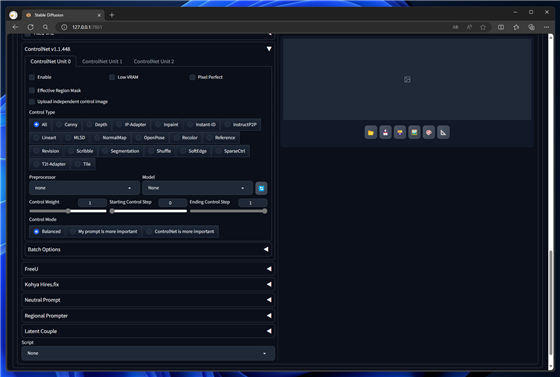

ページを下にスクロールし、[ControlNet]パネルを開きます。

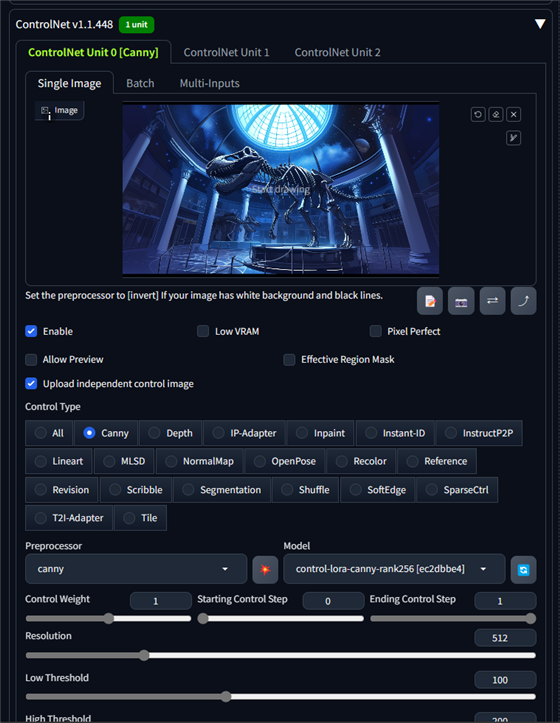

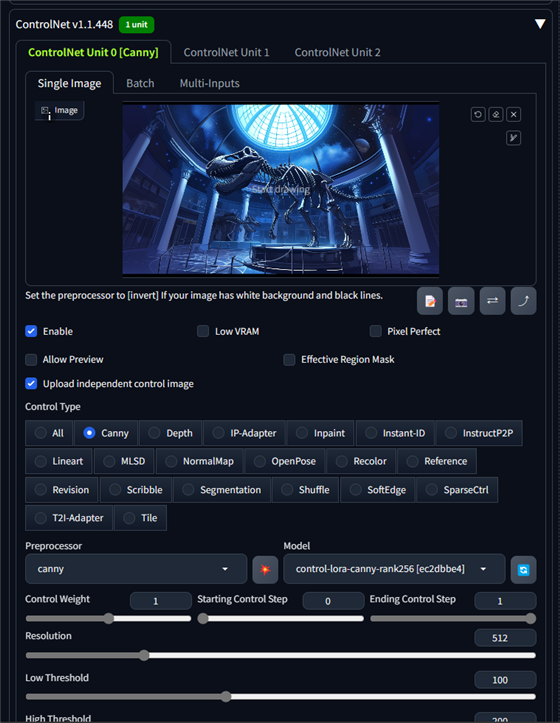

[Enable]チェックボックスをクリックしてチェックをつけます。[Upload independent contorl image]のチェックボックスをクリックしてチェックをつけます。

画像のアップロード枠が上部に表示されますので、元画像を入力します。

[Preprocessor]は"canny"を制定します。[Model]は "contorl-lora-canny-rank256" モデルハッシュ"ec2dbbe4" を設定します。

ControlNetのモデルについては

こちらの記事を参照してください。

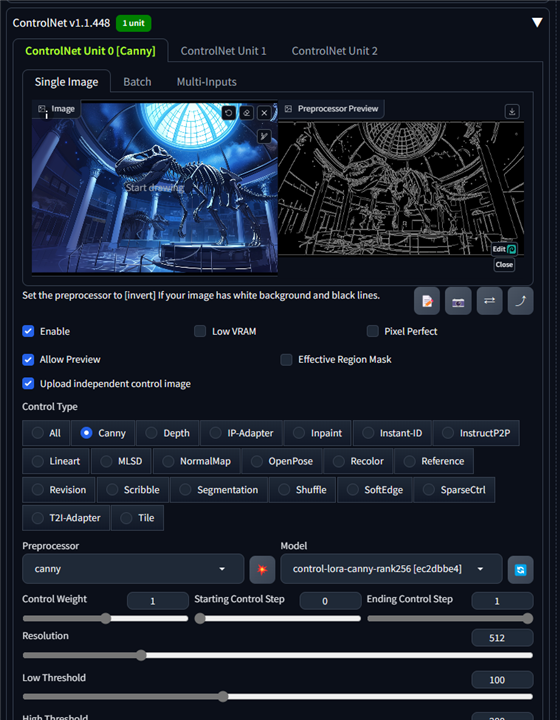

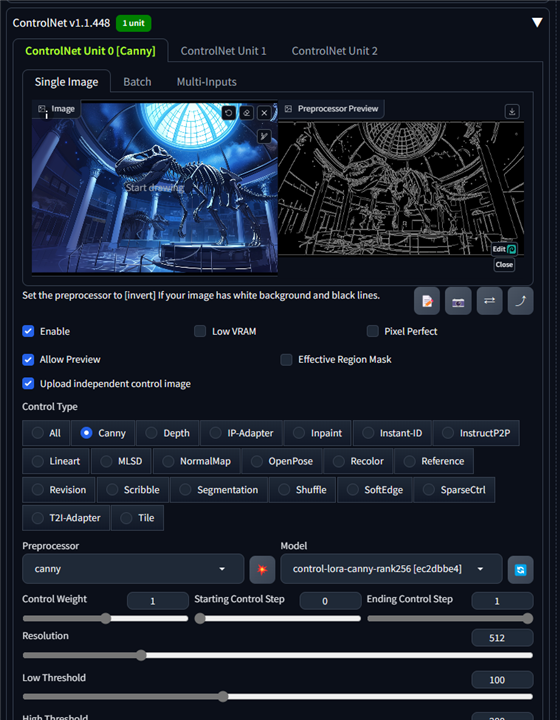

Preprocessorのドロップダウンリストの右側の[Run preprocessor]ボタンをクリックしてプロプロセッサを実行します。エッジが検出できた画像が右側に表示されます。

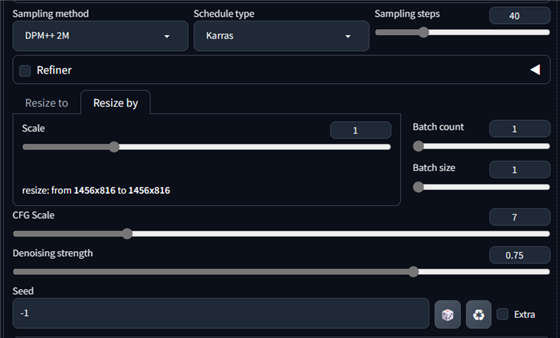

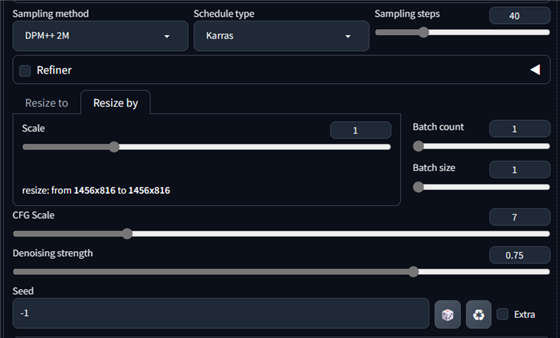

画像生成のサイズを指定します。[Resize by]で"1"を設定し元画像と同じサイズにします。Sampling methodは "DPM++ 2M" Schedule type は "Karras" Sapling steps は "40"としています。

Denoising strengthは"0.75"で画像生成を試します。

画像生成を実行します。プロンプトは以下を利用します。

モデルは若干リアル感の強めなAsync's MIX XLを利用しています。Animagine XLでは細部を描画しきれませんでした。

Prompt & Settings

Prompt: one tyrannosaurus skeleton, circle skylight, night museum, midnight, wide scene, (dark:1.2), dramatic lighting, masterpiece, best quality, aesthetic

Negative prompt: worst quality, low quality, light, illumination, person, human, people

Model: Async's MIX XL v3.1

下図の結果となりました。元画像のライティングの効果が強すぎるため、Denoising strengthをもう少し上げたほうが良さそうです。

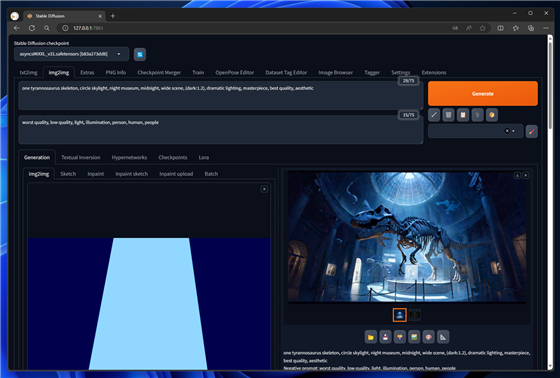

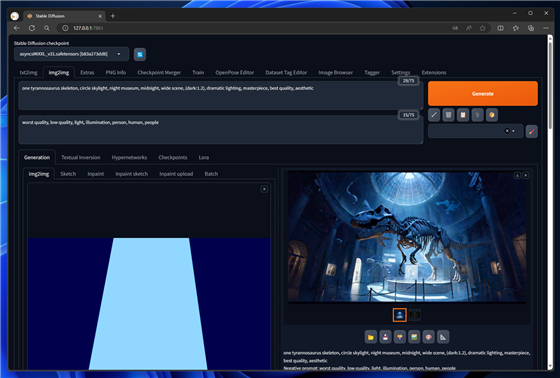

Denoising strengthを"0.9"にした結果が下図です。もう少しライティングを強くしたいです。

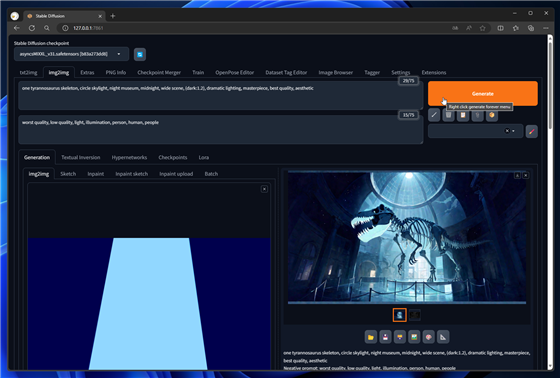

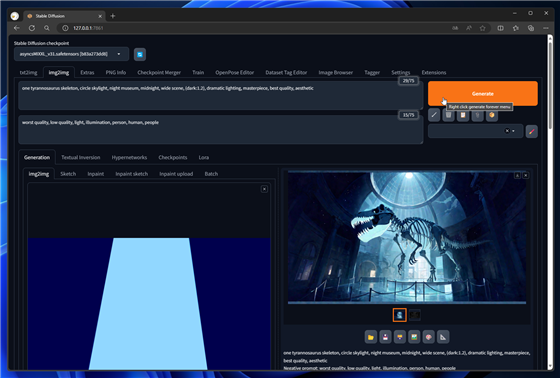

Denoising strengthを"0.85"にした結果が下図です。この設定にします。

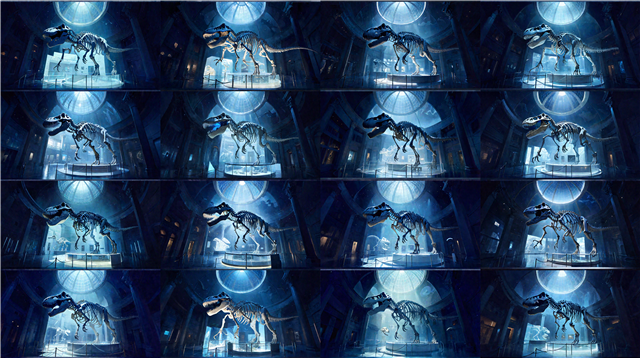

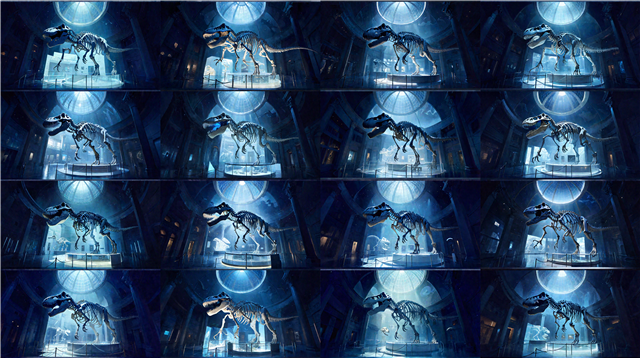

複数生成した実行結果は下図です。

こちらの画像を採用しました。

Stable Diffusionで元画像に対して、照明効果やカラーリングを指定した画像を生成できました。

著者

iPentecのメインデザイナー

Webページ、Webクリエイティブのデザインを担当。PhotoshopやIllustratorの作業もする。